Facebook a publié son rapport sur l’application des Standards de la communauté pour la période d’octobre à décembre 2020.

Ce rapport trimestriel présente les mesures prises par Facebook pour prévenir et sanctionner les contenus qui vont à l’encontre de ce que prévoient ses politiques, tout en protégeant la sécurité, la vie privée, la dignité et l’authenticité de la communauté.

Le dernier rapport montre des avancées positives et une plus grande transparence et responsabilité concernant les opérations de modération de contenu sur les différents produits Facebook. Il comprend des indicateurs relatifs à 12 des règles de Facebook et à 10 des règles d’Instagram.

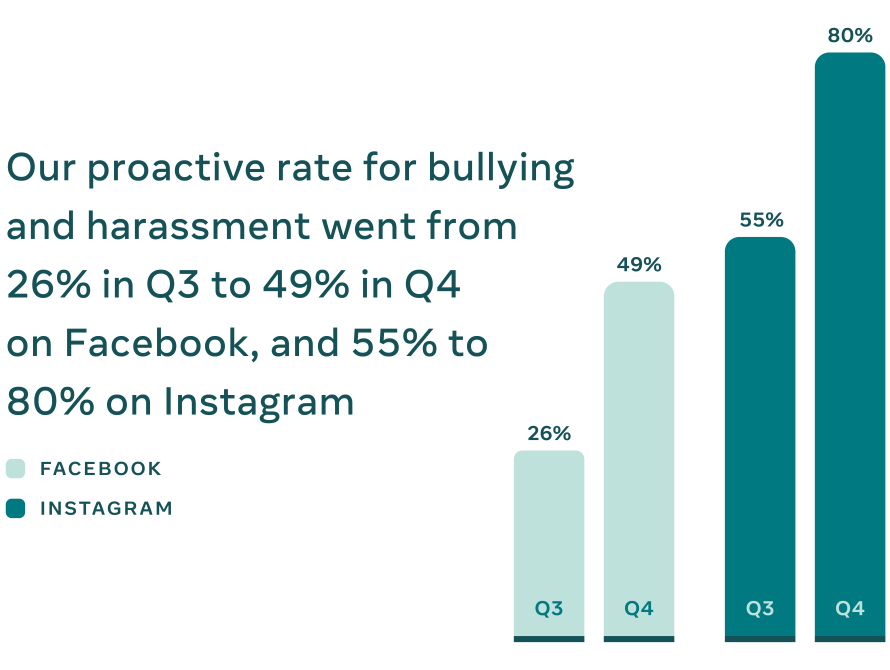

Au cours du 4e trimestre 2020, sur Facebook, certaines mesures contre :

- 6,3 millions de contenus d’intimidation et de harcèlement, contre 3,5 millions au troisième trimestre, en partie grâce aux mises à jour de notre technologie de détection des commentaires

- 6,4 millions d’éléments de contenu haineux organisés, contre 4 millions au troisième trimestre

- 26,9 millions de contenus de discours de haine, contre 22,1 millions au troisième trimestre, en partie grâce aux mises à jour de notre technologie en arabe, en espagnol et en portugais

- 2,5 millions de contenus sur le suicide et l’automutilation, contre 1,3 million au troisième trimestre, grâce à l’augmentation de la capacité des examinateurs.

SUR INSTAGRAM

- 5 millions d’éléments de contenu d’intimidation et de harcèlement, contre 2,6 millions au 3e trimestre, en partie grâce à la mise à jour de notre technologie de détection des commentaires

- 308.000 contenus haineux organisés, contre 224 000 au troisième trimestre

- 6,6 millions de contenus de discours haineux, contre 6,5 millions au troisième trimestre

- 3,4 millions de contenus sur le suicide et l’automutilation, contre 1,3 million au troisième trimestre, grâce à l’augmentation de la capacité des examinateurs

« Notre objectif est d’améliorer et de rendre plus efficace l’application de nos politiques en tant que communauté. Nous y parvenons en augmentant notre utilisation de l’intelligence artificielle (IA), en traitant en priorité les contenus susceptibles de causer le préjudice le plus immédiat, le plus étendu et le plus réel, et en coordonnant et en collaborant avec des experts extérieurs.« , a déclaré Kojo Boakye, Directeur des Affaires Publiques, Afrique.

Facebook prévoit de partager des mesures supplémentaires au sujet d’Instagram et d’ajouter de nouvelles catégories de règles sur Facebook. Des efforts sont également déployés pour vérifier de manière externe les indicateurs de ces rapports tout en rendant les données plus interactives afin que chacun puisse mieux les comprendre. Facebook continuera à améliorer sa technologie et ses efforts afin d’empêcher les contenus préjudiciables sur ses applications.